Ušli smo u godinu deepfake tehnologije, u vrijeme uređivanja videozapisa tako da se lažno prikažu snimke stvarnih ljudi i sadržaja koji se u stvarnosti nisu dogodili. Ne morate biti Orwell da zamislite što to znači za predsjedničke izbore, blaćenje protivnika, uvjerljivo širenje lažnih informacija, ali i za pornoindustriju koja bi na tome mogla naročito profitirati.

Zahvaljujući deepfakeu, netko iz Špičkovine moći će za vladaricu svoga srca izabrati Kim Kardashian, a romantična duša iz Ivanića uskočiti u zagrljaj Bradleyja Coopera. Gdje se u tome izgubila etika, pita se Davorka Grenac na Tportalu.

"Nitko kao ja ne voli toliko demokraciju i zato me je Bog izabrao", dao je izjavu Donald Trump kolumnistici Boston Globea Indiri Lakshmanan putem Skypea s ljetošnjeg sastanka na vrhu o demokraciji 2019. u Kopenhagenu.

Tisućama kilometara daleko američki je predsjednik u to vrijeme sudjelovao na samitu G20 u Osaki i nije imao pojma da je to rekao.

Nije ni mogao imati pojma jer je izjavu dala deepfake verzija Donalda Trumpa, video načinjen tako da ukaže na opasnost koju umjetna inteligencija i dezinformacija predstavljaju za izbore i politiku, objasnila je Lakshmanan.

Kako to zastrašujuće izgleda, pokazao je također isječak razgovora TV voditelja Davida Lettermana s glumcem Billom Haderom prošlog kolovoza na YouTubeu, tijekom kojega se Haderova faca pretvarala u lice Toma Cruisea. Autor uratka, slovački državljanin s prebivalištem u Češkoj, pod pseudonimom Tom, izjavio je za britanski The Guardian kako time pokušava podići svijest javnosti o subverzivnom potencijalu deepfakea. Šira javnost zna da se fotografije mogu obraditi u Photoshopu, ali još nema pojma da je to moguće učiniti s videozapisom, pojasnio je.

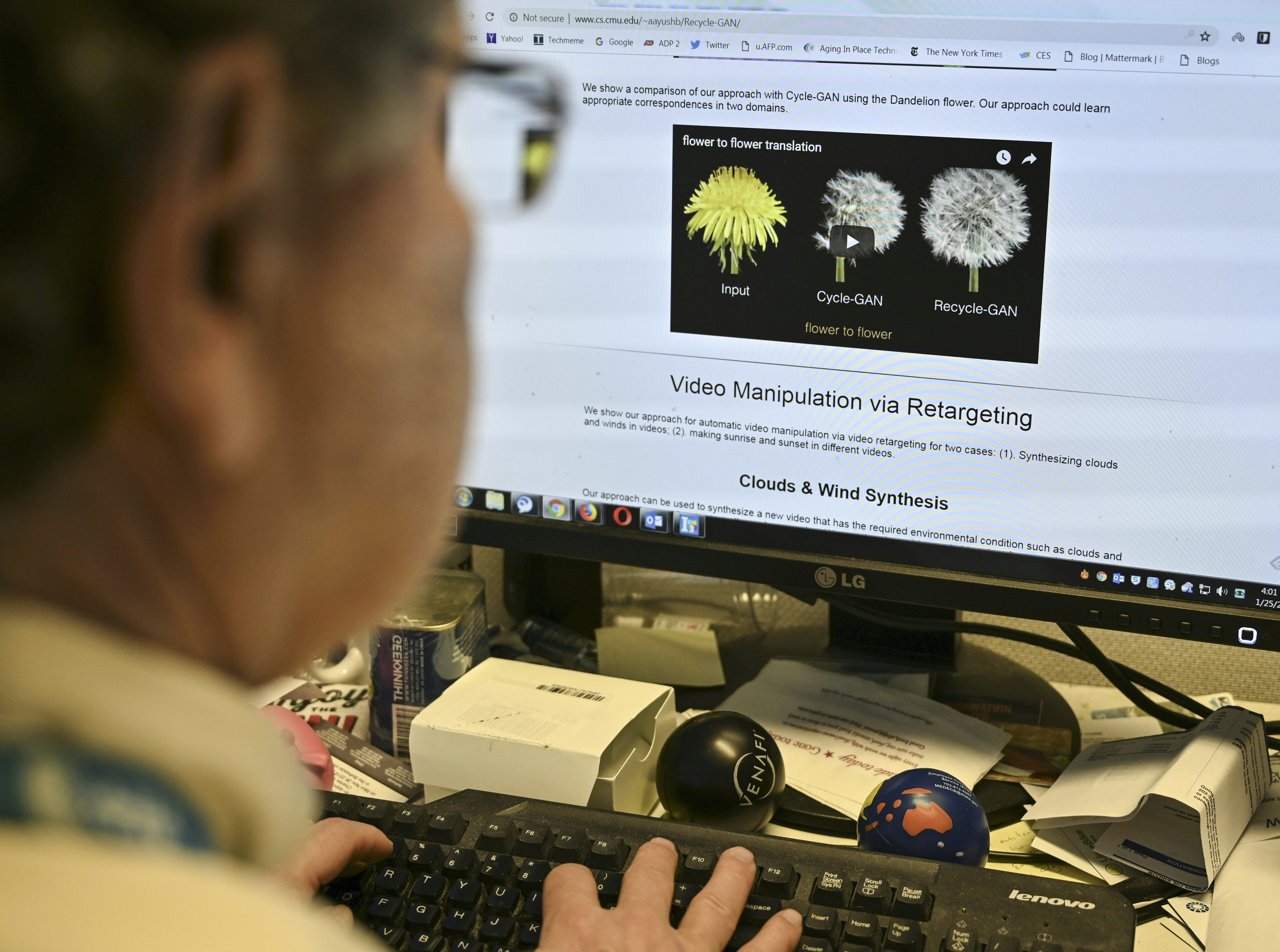

Deepfake tehnologija je editiranje videozapisa tako da se lažno prikažu snimke stvarnih ljudi i sadržaja koji se u stvarnosti nisu dogodili. Njome se otvara široko polje manipuliranja predsjedničkim izborima, difamiranja protivnika, blaćenja onih koji vam se ne sviđaju, uvjerljivo širenje lažnih informacija. Njome ćete moći stvoriti cijeli alternativni svijet po vlastitom ukusu. Aplikaciju je razvio kineski programer MoMo s idejom da korisnik svoje lice zamijeni licima poznatih glumaca, pjevača, političara te junaka videoigara.

Deepfake video i sextech branša "teška" 30 milijardi dolara

Na taj su način već obrađene poznate osobe poput Marka Zuckerberga, Baracka Obame i glumice Gal Gadot, poznate po ulozi Wonder Woman. Upravo primjer glumice Godot, smještene u pornouradak, pokazao je koliko daleko korisnici mogu ići sa svojim aplikacijama i utjecati ne samo na veliku politiku, nego i na jednu od najbrže rastućih industrija za odrasle – sextech branšu tešku 30 milijardi dolara.

Vješti programeri poput MoMoa i Toma mogu 'razodjenuti' poznate žene, dati im realistične dojke, stas, usne i genitalije. U javnosti su se tako pojavile razgolićene Taylor Swift, Ariana Grande, Emilia Clarke i Sophie Turner. Anonimni 'tehnološki entuzijast' pod pseudonimom Alberto otišao je korak dalje s novom aplikacijom za izradu pornića, koristeći u glavnim ulogama osobe koje nemaju pojma o tome. Zabrinuti stručnjaci za internetsku sigurnost stoga upozoravaju kako će uskoro biti moguće ugurati bilo koga u deepfake pornouradak.

U ne tako dalekoj budućnosti, kaže britanska seksologinja Tracey Fox, svatko će moći u kućnoj radinosti izraditi svog avatara. Ona predviđa da će najnoviji trendovi u proizvodnji pornosadržaja učiniti virtualni seks sličnijim stvarnom životu i omogućiti korisnicima ostvarenje najluđih fantazija, mijenjajući način na koji se doživljava seksualnost.

Anonimni pohotnik moći će virtualno općiti s klonom bilo koga i bilo kojeg celebrityja – netko iz Špičkovine moći će za vladaricu svoga srca izabrati Kim Kardashian, a romantična duša iz Ivanića uskočiti u zagrljaj Bradleyja Coopera.

Manipulacija digitalnim videom i slikama nije novost, ali razvoj umjetne inteligencije omogućava lakši pristup alatima za promjenu videozapisa i njegovu munjevitu distribuciju, a očekuje se da će tehnika postati pristupačnija običnim korisnicima.

Prema istraživanju Pewa o posljedicama seksualnog zlostavljanja provedenog u Australiji, Novom Zelandu i Velikoj Britaniji, proizvodnja i distribucija lažnih pornosadržaja za žrtve je podjednako destruktivna kao fizičko seksualno zlostavljanje. Oni zaključuju da u kockanju sa životima ljudi brutalan zaokret nastaje u doba deepfake tehnologije, pa britanski The Telegraph citira voditeljicu istraživačkog tima Clare McGlynn koja kaže:

"Nevještom oku vrlo je teško razlikovati lažne od stvarnih slika, zbog čega je podjednaka šteta od te vrste uznemiravanja i upada u tuđu privatnost i intimu. Kada naši sustavi umjetne inteligencije nisu usklađeni s etičkim vrijednostima, najčešće žrtve su žene."

Djelomična zaštita

Iz Tehnološkog instituta u Massachusettsu stiže vijest da je grupa američkih istraživača uspjela razviti novu tehnologiju digitalne forenzike koja svjetske lidere i slavne ličnosti može učinkovito zaštititi od deepfake upada. Ali što je s ostalima? Nemoguće je intervenirati u svakoj od milijuna mogućih objava spornih sadržaja, no radi se na algoritmima koji bi bili u stanju automatski razlučiti deepfake od originalnog videa.

'To je kao utrka u naoružanju – uvijek zaostajete nekoliko koraka u otkrivanju', kaže za Guardian Sean Gourley, osnivač i izvršni direktor firme Primer AI za analizu velikih skupova podataka.

U Britaniji i SAD-u priprema se novi zakon o zaštiti žrtava virtualnog nasilja, ali skeptici kažu da će od njega biti malo pomoći jer su sudska zabrana i kažnjavanje počinitelja dugačak proces, a šteta nepovratno učinjena. Za sada stoga ostaje tek upozoravajuća snimka preobrazbe Billa Hadera u Toma Cruisea i savjet Slovaka Toma: 'Naučite biti kritičniji. Ne vjerujte svemu što vidite na internetu.', piše Tportal.

Kakvo je tvoje mišljenje o ovome?

Pridruži se raspravi ili pročitaj komentare

Srbija

Srbija

Bosna i Hercegovina

Bosna i Hercegovina

Slovenija

Slovenija